Como parte del desarrollo de Google I/O 2025, Google presentó los avances significativos de Gemini 2.5, donde involucraba Gemini 2.5 Pro, el modelo más inteligente hasta el momento, además de una actualización anticipada de I/O para que los desarrolladores creen apps sorprendentes.

Como parte de la actualización anunciada de Gemini 2.5, Google indica:

- Gemini 2.5 Pro ahora es el modelo líder mundial en los rankings WebDev Arena y LMArena, y también ayudar a las personas a aprender.

- Google presenta nuevas capacidades de los modelos Gemini 2.5 Pro y Gemini 2.5 Flash: salida de audio nativo para una experiencia de conversación más natural, medidas de seguridad avanzadas y la habilidad de Project Mariner para usar computadoras.

- En esta línea, 2.5 Pro mejorará aún más con Deep Think, un modo experimental de razonamiento optimizado para matemática y programación de alta complejidad.

- Google sigue invirtiendo en la experiencia para desarrolladores, introduciendo resúmenes de pensamiento en la API de Gemini y en Vertex AI para aumentar la transparencia, extendiendo los presupuestos de pensamiento en 2.5 Pro para mayor control y agregando compatibilidad con herramientas MCP en la API de Gemeni y SDK para obtener acceso a más herramientas de código abierto.

- Por otra parte, Gemini 2.5 Flash ahora está disponible para todas las personas en la app de Gemini, y a principios de junio nuestra versión actualizada entrará en disponibilidad general en Google AI Studio para desarrolladores y en Vertex AI para empresas.

Este notable avance es el resultado del esfuerzo permanente de los equipos de Google para mejorar las tecnologías y para desarrollarlas y lanzarlas de manera segura y responsable.

Gemini 2.5 Pro tiene mejor rendimiento que nunca

Recientemente Google actualizó Gemini 2.5 Pro para ayudar a los desarrolladores a crear apps web interactivas más interesantes.

Y es que además de su sólido rendimiento en comparativas académicas, el nuevo modelo 2.5 Pro ahora lidera el reconocido ranking de programación WebDev Arena, con una puntuación ELO de 1415. También lleva la delantera en todas las tablas de clasificación del ranking LMArena, que evalúa la preferencia de los humanos en varias dimensiones. Y con su ventana de contexto de un millón de tokens, 2.5 Pro tiene un rendimiento de vanguardia en contexto extenso y comprensión de video.

Desde la incorporación de LearnLM, nuestra familia de modelos creados con especialistas en educación, 2.5 Pro ahora es también el modelo líder de aprendizaje. En comparaciones mano a mano para evaluar su pedagogía y efectividad, educadores y expertos eligieron Gemini 2.5 Pro por sobre otros modelos en una amplia gama de escenarios. También se destacó superando a los principales modelos en cada uno de los cinco principios de las ciencias de aprendizaje utilizados para construir sistemas de IA para la enseñanza.

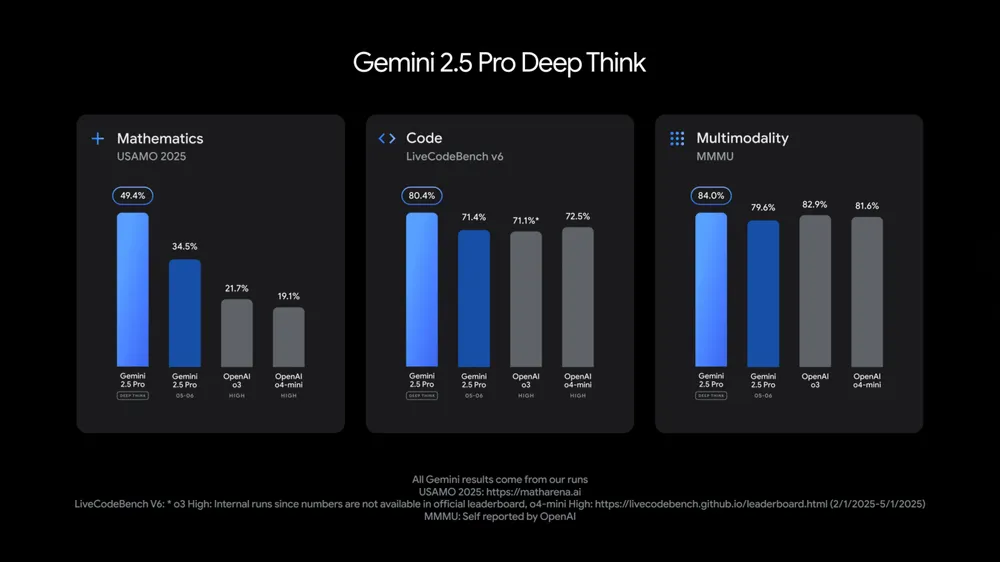

Deep Think en Gemini

A través de la exploración de los límites de la capacidad de pensamiento de Gemini, Google está probando un modo de razonamiento mejorado llamado Deep Think. Este modo usa nuevas técnicas de investigación, lo que le permite al modelo considerar múltiples hipótesis antes de responder.

Gemini 2.5 Pro Deep Think tiene una impresionante puntuación en 2025 USAMO, actualmente una de las comparativas de matemática más estrictas. También lidera en LiveCodeBench, una prueba de rendimiento difícil para la codificación a nivel de competición, y obtiene un 84.0% en MMMU, que evalúa el razonamiento multimodal.

Google Gemini 2.5 Flash, aún mejor

Gemini 2.5 Flash es el modelo más eficiente diseñado para ofrecer velocidad a bajo costo, y ahora es mejor en muchas dimensiones.

Y es que Flash está optimizado en comparativas clave para razonamiento, multimodalidad, programación y contexto extenso, al tiempo que mejora su eficiencia, usando un 20-30% menos tokens en nuestras evaluaciones.

Y es que el nuevo modelo 2.5 Flash ahora está disponible en versión preliminar en Google AI Studio para desarrolladores, en Vertex AI para empresas y en la app de Gemini para todas las personas.

Nuevas capacidades de Gemini 2.5

Salida de audio nativo y mejoras a la API de Live

En la API de Live hoy, Google introdujo una versión preliminar de diálogo con entrada audiovisual y salida de audio nativo para que puedas crear experiencias de conversación de forma directa con una versión de Gemini más natural y expresiva.

También permite a los usuarios ajustar el tono, el acento y el estilo del habla. Por ejemplo, puedes pedirle al modelo que utilice una voz dramática cuando cuente una historia. Y es compatible con el uso de herramientas, para poder buscar en tu nombre.

También puedes experimentar con un conjunto de herramientas preliminares, que incluye las siguientes:

- Diálogo afectivo: el modelo detecta las emociones en la voz del usuario y responde en función de ello.

- Audio proactivo: el modelo ignora las conversaciones de fondo y sabe cuándo responder.

- Razonamiento en la API de Live: el modelo aprovecha las capacidades de razonamiento de Gemini para poder realizar tareas más complejas.

Seguridad mejorada

Google incrementó de manera significativa la protección contra amenazas de seguridad, como la inyección de instrucciones indirectas (cuando instrucciones maliciosas se incorporan en los datos que recupera un modelo de IA).

Y es que el nuevo enfoque de seguridad ayudó en gran medida a incrementar la tasa de protección de Gemini contra los ataques de inyección de instrucciones indirectas durante el uso de herramientas, haciendo de Gemini 2.5 nuestra familia de modelos más segura hasta el momento.

Experiencia mejorada para desarrolladores

Resúmenes de pensamiento

2.5 Pro and Flash ahora incluirán resúmenes de pensamiento en la API de Gemini y en Vertex AI. Estos resúmenes toman los pensamientos sin procesar del modelo y los organizan en un formato claro, con encabezados, datos clave y la información sobre las acciones del modelo, como el uso de herramientas.

Esperamos que, con un formato más estructurado y organizado del proceso de pensamiento, sea más fácil para desarrolladores y usuarios comprender y depurar las interacciones con los modelos de Gemini.

Compatibilidad con MCP

Google agrega compatibilidad nativa con el SDK para las definiciones del Protocolo de Contexto de Modelo (MCP) en la API de Gemini para una integración más sencilla con herramientas de código abierto. También estamos explorando formas de implementar servidores MCP y otras herramientas alojadas para que te resulte más fácil crear aplicaciones con capacidad de agente.