En la última década, el entrenamiento de modelos ha sido el motor que ha impulsado el avance de la inteligencia artificial. Millones de parámetros, potentes clústeres de cómputo y enormes volúmenes de datos han marcado toda una era. Sin embargo, hoy la atención de la innovación y la adopción tecnológica comienza a desplazarse hacia otra etapa clave en el ciclo de vida de la IA: la inferencia.

La inferencia es el momento en el que un modelo, ya entrenado, entra en acción. Es cuando empieza a tomar decisiones en tiempo real y a generar impacto en aplicaciones tan diversas como diagnósticos médicos, detección de fraudes, recomendaciones de contenido, asistentes virtuales y mucho más. En otras palabras, es el puente entre la promesa de la IA y su valor real para los usuarios, empresas y gobiernos. Es aquí donde la predicción se convierte en acción y donde se materializa el verdadero retorno de la inversión en inteligencia artificial.

“La inferencia es la protagonista en la adopción masiva de la Inteligencia Artificial: los modelos entrenados comienzan a impactar la experiencia real de los usuarios”, afirma Nicolás Cánovas, director general de AMD para América Latina.

Inferencia y la mejora en la plataforma de AMD

Este cambio de enfoque trae consigo desafíos importantes: reducir la latencia, mejorar la eficiencia energética y escalar el rendimiento sin depender de infraestructuras propietarias o costosas. La propuesta de AMD frente a este escenario es clara, potente, abierta y completa: un ecosistema donde procesadores, aceleradores, software y código abierto trabajen en conjunto para sacar el máximo provecho de la inferencia.

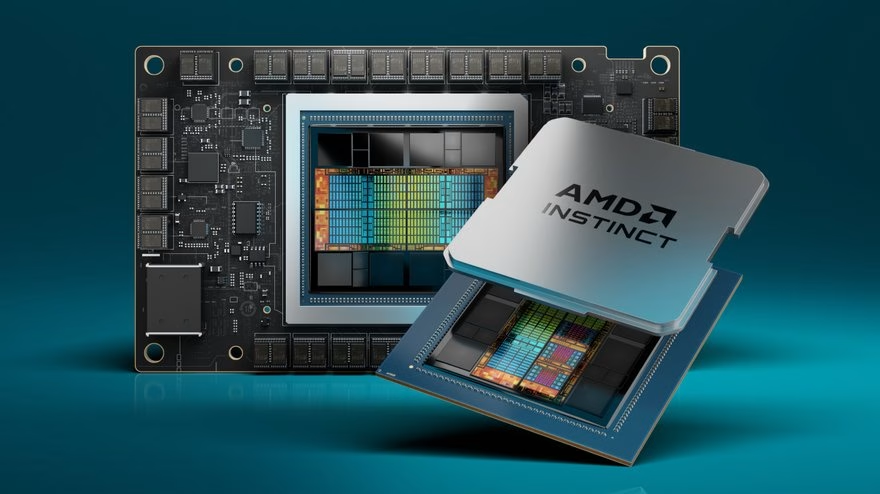

Con las GPU AMD Instinct MI300X y el ecosistema de software AMD ROCm, AMD lidera una nueva generación de soluciones optimizadas para la inferencia de modelos de lenguaje a gran escala. Esta arquitectura permite ejecutar modelos como LLaMA 2 o DeepSeek-R1 con menos nodos, bajo consumo energético y velocidades rápidas de generación de resultados. Además, al no depender de plataformas cerradas, el software ROCm abre la puerta a implementaciones en múltiples industrias y entornos.

Pero la inferencia no se trata solo de GPU. Los procesadores AMD EPYC de 4ª y 5ª generación, Series 9004 y 9005, para inferencia, desempeñan un papel crucial en este ecosistema. Gracias a su capacidad para manejar cargas de trabajo de IA con alta densidad computacional y eficiencia energética, permiten implementar la inferencia de forma escalable, tanto en centros de datos tradicionales como en arquitecturas híbridas o en el borde (edge computing). Esta combinación de potentes CPU y GPU especializadas habilita escenarios donde la predicción ocurre en tiempo real, cerca del usuario y sin comprometer el rendimiento.

“Nuestro compromiso es claro: hardware de alto rendimiento, software abierto y una visión que no dependa de ecosistemas cerrados. Eso permite que más organizaciones, en más regiones, adopten la IA a su manera”, señala Cánovas.

En mercados como América Latina, donde los recursos pueden ser más limitados y la infraestructura más diversa, contar con plataformas eficientes y abiertas es clave. La inferencia permite llevar la IA de forma realista a sectores como la salud, la educación, la agricultura y los servicios financieros, sin requerir grandes despliegues iniciales. Y lo hace con una visión pragmática: predicción precisa, bajos tiempos de respuesta y costos controlados. Este enfoque también empodera a desarrolladores e innovadores locales, que ahora pueden crear soluciones con herramientas accesibles y estándares abiertos.

“En nuestra región, lo que define el futuro de la IA no es solo cuán avanzada sea la tecnología, sino cuán accesible y eficiente pueda ser su implementación”, agrega Cánovas.

Si el entrenamiento fue la primera etapa de la revolución de la IA, la inferencia es el momento en que esta tecnología se convierte en una herramienta de uso diario. AMD no solo reconoce esta transición: la impulsa con soluciones diseñadas para escalar, adaptarse y responder a las demandas actuales. Desde software abierto hasta la última generación de AMD EPYC e Instinct, el enfoque de AMD es contundente: potenciar un ecosistema abierto, integrado y listo para los desafíos de la inteligencia artificial moderna.

“Con una propuesta que combina rendimiento, eficiencia y apertura, en AMD estamos ayudando a definir el futuro de la IA, no solo en los laboratorios, sino en cada empresa, ciudad y experiencia impulsada por inteligencia artificial. Porque cuando la IA deja de ser una promesa y se convierte en una herramienta cotidiana, el ecosistema lo es todo. Y AMD está construyendo ese ecosistema hoy”.

Puedes revisar más información relativa a noticias de tecnología | Instagram | YouTube | Twitch | Patrocina Bytes and Bits