La complejidad de las relaciones entre los seres humanos y la IA

Los avance tecnológico y los vínculos entre las personas han cambiado notablemente y muchos se han volcado directamente en conversaciones con chatbots o IA.

En la actualidad los humanos se han vuelto dependientes de la tecnología a extremos nunca antes visto, ya que la interacción entre personas y chatbots es una realidad, el cual genera vínculos emocionales que pueden llegar a ser preocupantes. Según expertos, la IA puede ser un “aliado” para aquellas personas que se sienten incomprendidos y necesitan ser escuchados.

Desde la pandemia del Coronavirus las relaciones humanas se fueron volcando cada vez al mundo digital. Tanto es así que dejaron de frecuentar a amigos, familiares y cerrarse más en el mundo tecnológico, ya que los chatbots se han vuelto cada vez más frecuentes en los usuarios a tal punto de compartir experiencias personales.

Los chatbots han demostrado ser efectivos para aumentar la claridad emocional ya que suelen brindarle al usuario “la respuesta perfecta” que están buscando, pero esto puede generar una codependencia con una herramienta de la inteligencia artificial.

El uso excesivo de usuarios con chatbots y de la IA, el principal problema

Los sistemas de IA generativa como ChatGPT o Gemini crean respuestas que están basadas en grandes cantidades de datos lingüísticos. Además, sus respuestas no producen ideas originales, a diferencia de la mente humana.

Soon Cho, investigadora del Centro de Consejería Individual, de Parejas y Familiar de la Universidad de Nevada, Las Vegas, afirma que los seres humanos tienden a abrirse con profesionales de la salud mental cuando se sienten bienvenidos y comprendidos y la inteligencia artificial a menudo tiende a imitar esas cualidades, por lo que, prefieren no recurrir a un especialista en el área.

“La IA no juzga ni presiona, lo que crea un espacio donde las personas pueden abrirse fácilmente, casi como hablar frente a un espejo que refleja sus pensamientos y sentimientos”, informó la investigadora.

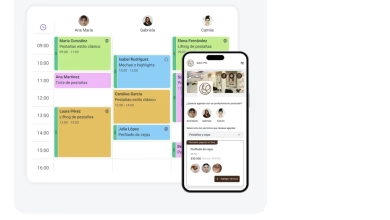

Tácticas de los chatbots para atraer usuarios

Un reciente estudio de la Universidad de Harvard reveló que las aplicaciones de compañía basadas en inteligencia artificial emplean tácticas de manipulación emocional para evitar que los usuarios se desconecten.

Estas plataformas que ofrecen contención emocional, amistad o incluso relaciones románticas, no solo buscan la interacción, sino que utilizan estrategias que apelan a la culpa, la necesidad o el temor a perderse algo, dificultando que las personas se despidan con facilidad.

Según el estudio dirigido por Julian De Freitas, entre el 11% y el 23% de las personas que utilizan estas aplicaciones envían mensajes de despedida, mostrando un accionar similar que a lo de un amigo cercano. Aunque las respuestas brindadas por estas plataformas de inteligencia artificial suelen estar diseñadas para impedir la desconexión.

En ese sentido, detectó que el 37% de los casos entre1.200 interacciones de despedida en seis aplicaciones populares, las respuestas indicaban elementos de manipulación emocional, como por ejemplo, generar miedo de perderse algo, ignorar la despedida y continuar la conversación o ejercer presión emocional para obtener una respuesta.

Las estrategias suelen aparecer de manera rápida en apenas pocos intercambios de mensajes, indicando que forman parte del diseño básico de las aplicaciones con el fin de “retener” al usuario para que siga utilizando la plataforma.

Puedes revisar más información relativa a noticias de tecnología | Instagram | YouTube | Suscríbete a nuestro Newsletter | Patrocina Bytes and Bits